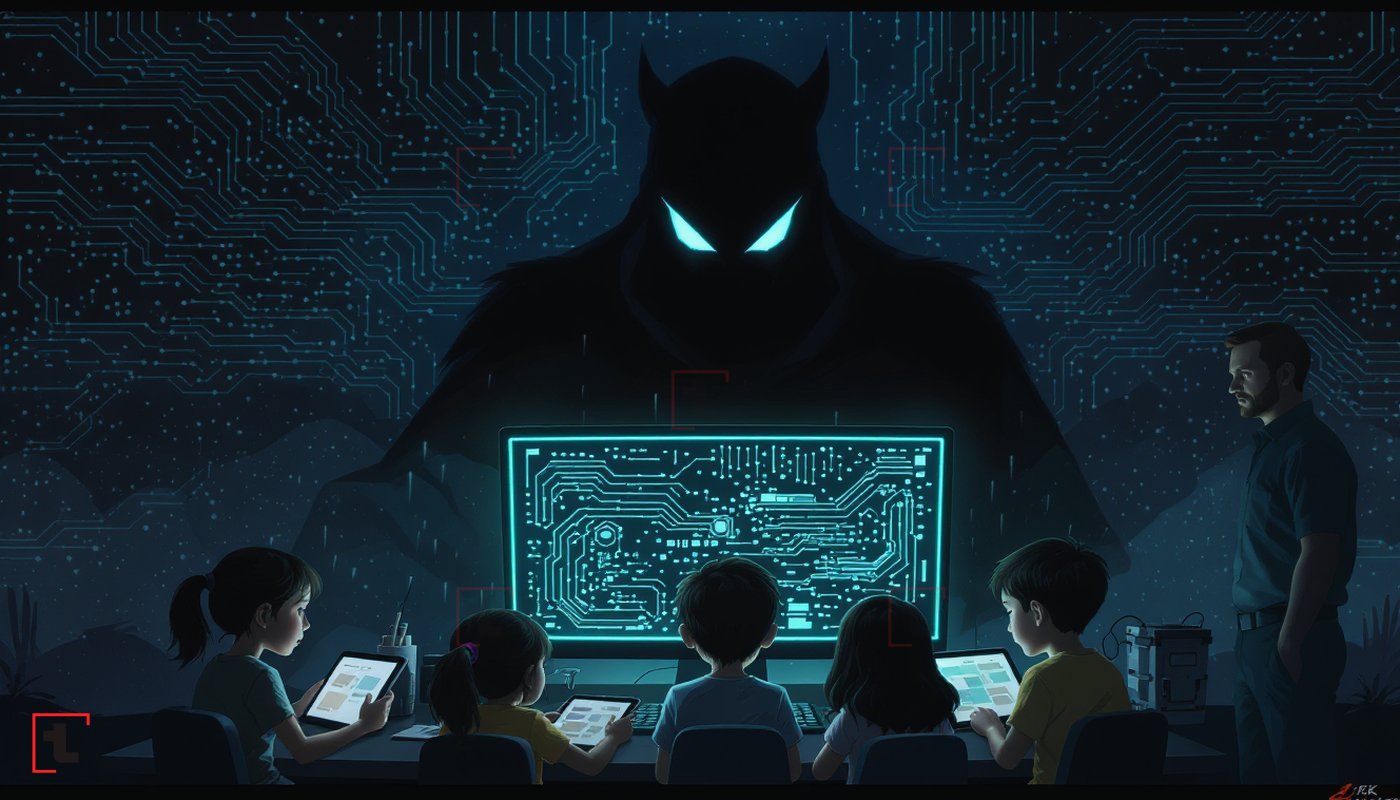

OpenAI xəbərdarlıq edir: Uşaq istismarı ilə bağlı hesabatlar niyə artır?

...

Süni intellekt

Oxumaq vaxt alır?

Məqalələri dinləyə bilərsizOpenAI və Uşaq İstismarına Qarşı Mübarizə

OpenAI 2025-ci ilin ilk yarısında uşaq istismarı ilə bağlı 75000-dən çox hesabat təqdim edib. Bu rəqəm, 2024-cü ilin eyni dövrü ilə müqayisədə 80 dəfəlik bir artımı göstərir. Hesabatlar ABŞ-ın Milli Uşaq İstismarı və İtkin Uşaqlar Mərkəzinə (NCMEC) göndərilib və bu, süni intellekt texnologiyalarının təhlükəsizlik sahəsindəki təsirini ön plana çıxarır.

Artımın Səbəbləri

OpenAI nümayəndəsi Gaby Raila bildirib ki, şirkət 2024-cü ilin sonunda hesabatların araşdırılması və idarə olunması üçün resurslarını artırıb. Bu dövr həm də OpenAI məhsullarında yeni funksiyaların, o cümlədən görüntü yükləmə imkanlarının tətbiqi ilə üst-üstə düşüb. Raila qeyd edib ki, bu yeniliklər və məhsulların populyarlığının artması hesabatların sayının çoxalmasına səbəb olub.

Statistik Məlumatların Təhlili

2025-ci ilin ilk yarısında OpenAI tərəfindən təqdim edilən hesabatların sayı 75027 olub, bu hesabatlarda 74559 kontent parçası qeyd edilib. 2024-cü ilin eyni dövründə isə cəmi 947 hesabat təqdim edilmişdi və 3252 kontent parçası əhatə olunmuşdu. Bu rəqəmlər süni intellektin uşaq istismarı ilə bağlı problemlərin aşkarlanmasında daha geniş rol oynadığını göstərir.

Süni İntellekt və Qlobal Təhlükəsizlik Problemləri

NCMEC-in məlumatlarına görə, generativ süni intellektlə bağlı hesabatlar 2023 və 2024-cü illər arasında 1325 faiz artıb. Bu, süni intellekt texnologiyalarının qlobal miqyasda təhlükəsizlik məsələlərinə təsirini daha da vurğulayır. Digər böyük süni intellekt laboratoriyaları, o cümlədən Google, öz hesabatlarını təqdim etsə də, generativ süni intellektlə bağlı konkret statistik məlumatları paylaşmayıblar.

Uşaq Təhlükəsizliyini Qorumaq Üçün Yeni Addımlar

OpenAI son aylarda təhlükəsizliyə yönəlmiş yeni alətlər təqdim edib. Sentyabr ayında valideynlər üçün nəzarət funksiyaları əlavə edilib. Bu funksiyalar valideynlərə uşaqlarının hesablarını idarə etmək, müəyyən rejimləri deaktiv etmək və model təlimindən imtina etmək imkanı verir. Şirkət həmçinin öz sistemində özünə zərər verə biləcək əlamətlər aşkar edildikdə valideynləri və lazım gəldikdə hüquq-mühafizə orqanlarını xəbərdar edə biləcəyini bildirib.

Hüquqi Məsələlər və Gələcək Planlar

Oktyabr ayında OpenAI Kaliforniya Ədliyyə Departamenti ilə danışıqların sonunda süni intellektin inkişafı ilə bağlı risklərin azaldılması öhdəliyini götürüb. Noyabr ayında şirkət 'Teen Safety Blueprint' adlı bir sənəd yayımlayaraq uşaq istismarı ilə mübarizə sahəsindəki fəaliyyətlərini genişləndirdiyini bəyan edib. Şirkət bu sahədə texnologiyalarını daha da təkmilləşdirməyi və təsdiqlənmiş hallar barədə aidiyyəti orqanlara məlumat verməyi davam etdirəcəyini bildirib.

İnsanlara Təsiri

Uşaq istismarı ilə bağlı hesabatların artması texnologiyanın təhlükəsizlik məsələlərindəki əhəmiyyətini bir daha ortaya qoyur. Süni intellektin geniş yayılması ilə bu cür problemlərin daha tez aşkarlanması mümkün olsa da, eyni zamanda bu texnologiyaların riskləri də ciddi şəkildə nəzərə alınmalıdır. Valideynlər, hüquq-mühafizə orqanları və texnologiya şirkətləri arasında əməkdaşlıq bu problemlərin həlli üçün vacibdir.